SIGMA课题组提出全球首个亿级遥感视觉Transformer大模型

近日,在杜博教授的带领下, SIGMA课题组联合京东探索研究院与悉尼大学,提出了全球首个面向遥感任务设计的亿级视觉Transformer大模型。该模型针对具有1亿参数的一般结构的ViT (Plain ViT),采用掩码图像建模算法进行无监督预训练获得初始权重,进而设计出符合遥感图像特点的旋转可变窗口注意力机制来代替Transformer中的原始完全注意力,能够有效应对遥感图像具有的大尺寸特性和遥感目标的朝向任意性,并应用到多种遥感任务中。该成果已被遥感领域顶级期刊IEEE TGRS接收,论文题目为:“Advancing Plain Vision Transformer Towards Remote Sensing Foundation Model”。团队成员包括论文通讯作者杜博教授和第一作者2021级博士生王迪,模型和代码均已开源!

实验表明,在遥感目标检测任务上,该模型优于目前为止所有最先进的模型,其在DOTA-V1.0数据集上取得了81.24% mAP的最高精度。而在下游分类和分割任务上,该模型与现有先进方法相比具有很好的竞争力。此外,该模型具有训练代价低的特点,并在迁移学习的样本效率、可解释性等方面具有明显优势。

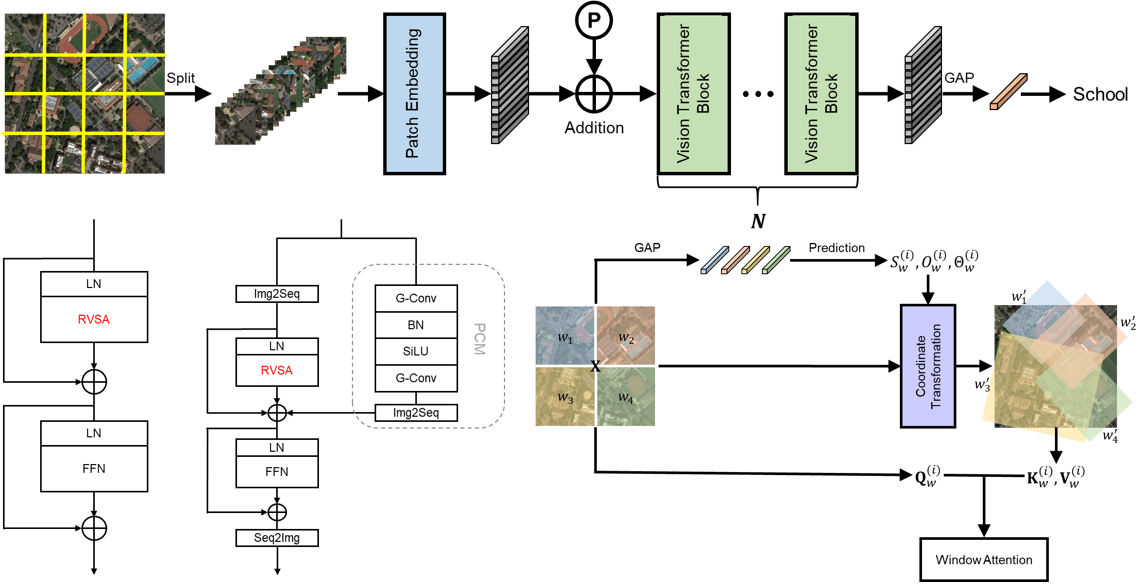

模型的网络结构,模块内部结构和所提出的注意力机制:

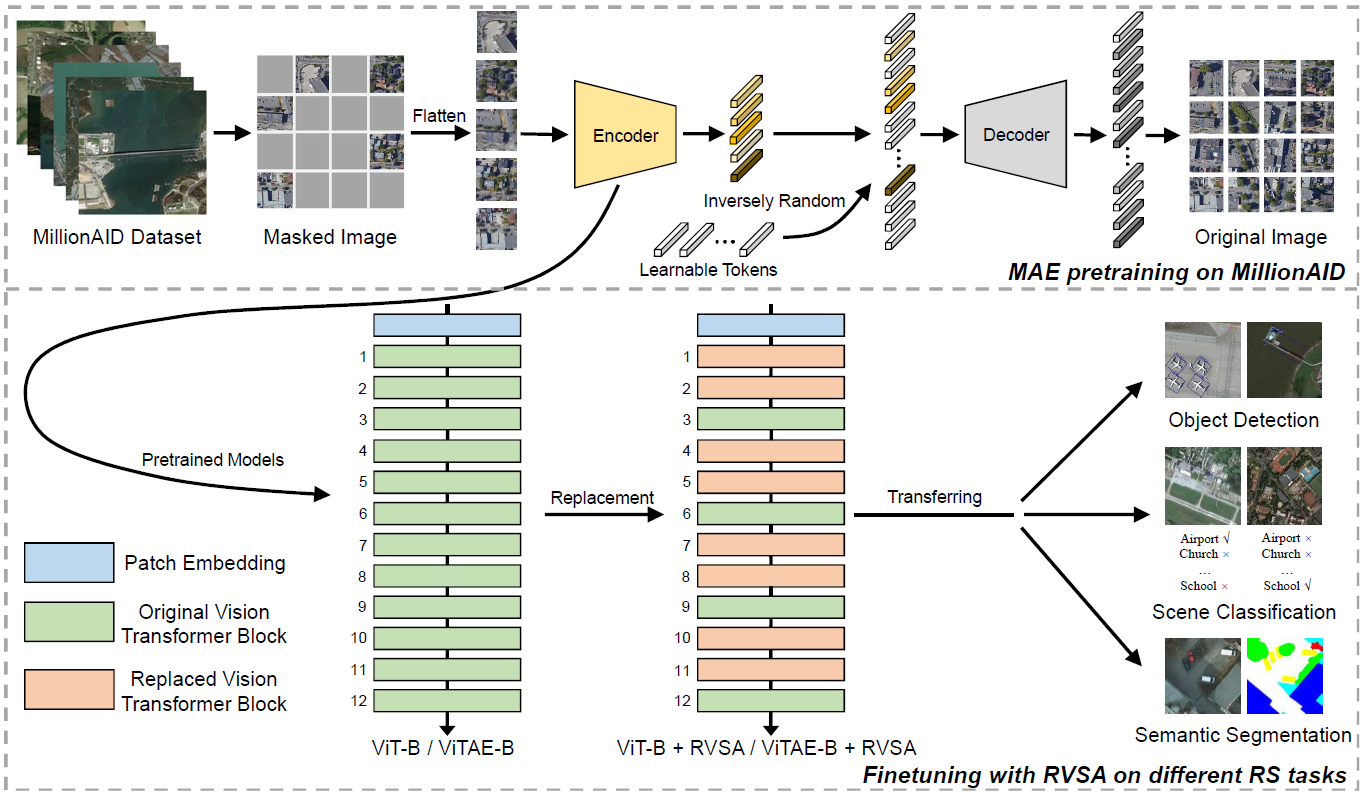

模型预训练和微调的框架:

模型具有高精度:

模型具有低训练代价:

模型具有良好的迁移学习训练数据效率:

模型可解释性强(其中c, d, e是模型生成的注意力窗口)

论文引用及链接:

[1]Di Wang, Qiming Zhang, Yufei Xu, Jing Zhang, Bo Du, Dacheng Tao and Liangpei Zhang, Advancing Plain Vision Transformer Towards Remote Sensing Foundation Model, IEEE TGRS, 2022.

https://ieeexplore.ieee.org/document/9956816

项目地址:

https://github.com/ViTAE-Transformer/Remote-Sensing-RVSA